Prospero est un robot en cours de développement qui va permettre de cultiver des champs entier d’une manière autonome. Est ce que cela sera une solution pérenne pour enrayer la crise de nourriture ?

Au fil de l’évolution de l’humanité, l’agriculture a toujours été assisté, que ce soit dans un premier temps avec des animaux, puis des machines. Est ce que les robots fermiers autonomes seront la prochaine évolution de l’agriculture ?

Comme on peut le constater, la production de nourriture croit d’une manière linéaire, tandis que la population humaine croit d’une manière plutôt exponentielle, et tôt ou tard, la demande de nourriture risque d’être supérieure à la production.

Et le point commun de l’agriculture au fil du temps a toujours été l’homme.

C’est donc pour essayer de rendre cette production autonome que Propero a été créé avec 4 phases de développement :

• Phase 1 : Planter des graines.

• Phase 2 : Entretenir la culture.

• Phase 3 : Récolter.

• Phase 4 : Intégrer les 3 phases en un seul robot autonome.

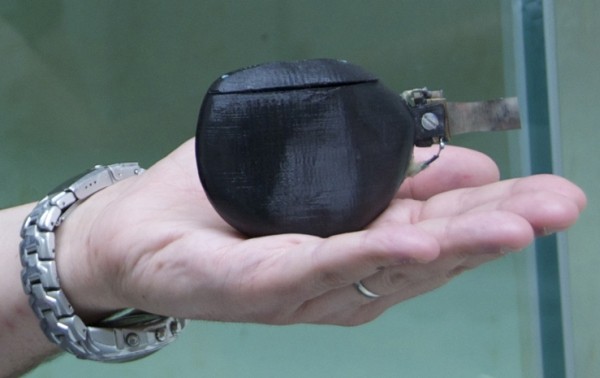

Le robot Propero, n’en ai pour le moment qu’à la phase 1. Ce robot, conçu sur le modèle du robot hexapode Propeller de Parallax, fonctionne en mode essaim, à plusieurs ils couvrent toute une parcelle et discute en eux à l’aide de liaison sans fil.

Chacun scrute le sol pour savoir si une graine n’a pas déjà été planté, puis détermine l’espace optimum pour en planter une à la profondeur encore optimum en fonction de l’état du sol. Il enregistre ensuite précisément cette position afin de pouvoir lui appliquer par la suite (phase 2) différents engrais et insecticide.

Alors, en voyant la vidéo qui suit, on pourrait se croire dans un film de science fiction, et pourtant Prospero fonctionne déjà en mode phase 1.